Imagen de una persona utilizando un teléfono móvil

Moderadores de TikTok en Barcelona explican su experiencia: Había "decapitaciones o mutilaciones"

Los responsables de la compañía subcontratada por la plataforma niegan el contenido violento

Hasta 29 exmoderadores se querellan contra Meta en Barcelona por las secuelas de visionar imágenes violentas

Noticias relacionadas

Moderadores que trabajaron para Majorel SP Solutions, S.A.U., con sede en Barcelona y dedicada a la moderación de contenidos de TikTok, han declarado ante Europa Press que revisaban material violento, incluyendo "decapitaciones o mutilaciones".

Una exempleada señaló que, aunque no ocurría todos los días, la exposición era lo suficientemente frecuente como para afectarle emocionalmente: "En ocasiones, nos topábamos con vídeos con escenas muy violentas, como decapitaciones o mutilaciones mientras las víctimas seguían vivas".

Negación de la empresa y testimonios coincidentes

Tres responsables de la empresa negaron ante el Juzgado de Instrucción 9 de Barcelona que los trabajadores revisaran contenido audiovisual altamente perturbador, o que si lo hacían, era de forma residual, según el abogado Francesc Feliu, representante legal de la querellante.

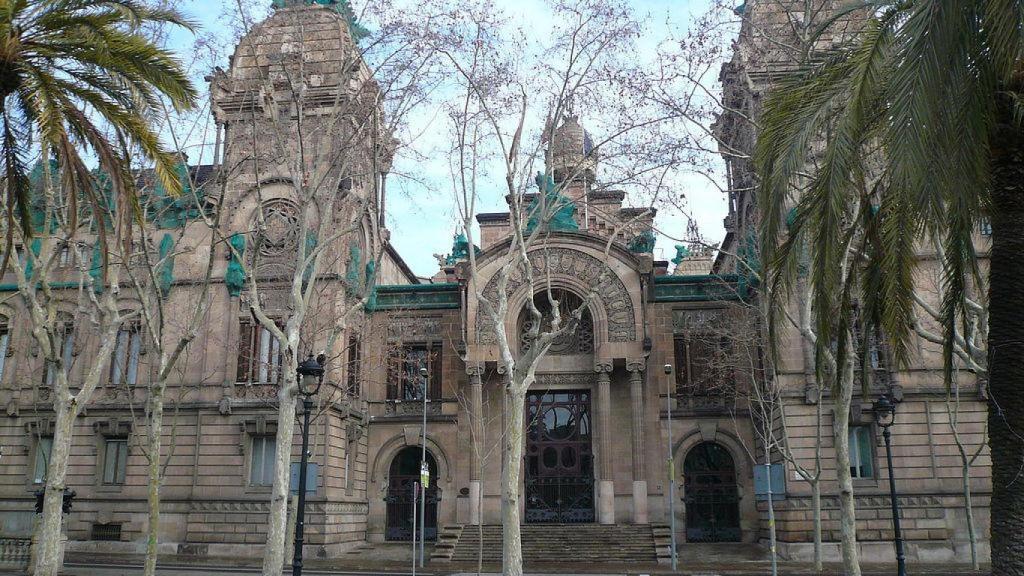

Audiencia Provincial de Barcelona en imagen de archivo

La exempleada afirmó que, aunque la exposición no era continua, sí tuvieron que enfrentarse a contenido explícito, especialmente durante conflictos armados, cuando "llegaba material especialmente duro".

Otra extrabajadora confirmó haber visto decapitaciones y contenido sexual, pero de forma esporádica, ya que la mayoría de los vídeos eran musicales, y por ello no cree haber sufrido impacto psicológico: "Se colaba algún vídeo, pero en general no eran duros".

Posibilidad de pausas y distribución del trabajo

A diferencia de la querellante, la primera extrabajadora señaló que podían parar o no moderar hasta el final de los vídeos, y que siempre había psicólogos disponibles: "Podíamos parar e incluso no moderar hasta el final y había psicólogos con los que podíamos hablar en cualquier momento. En eso no puedo quejarme".

Sobre la distribución del trabajo, explicó que en la sede de Majorel Barcelona existían dos departamentos: los empleados de TikTok1 veían el contenido más violento, mientras que el de TikTok2 recibía material ya revisado y menos impactante.

Impacto emocional y depresión

La misma exempleada relató que, en un momento personal complicado, un conflicto armado coincidió con su trabajo y los contenidos que tuvo que revisar le afectaron profundamente: "Tuve que ver imágenes horribles que me impactaron mucho".

Como consecuencia, cayó en depresión, aunque continuó trabajando y asegura que no recibió apoyo ni de la empresa ni de sus compañeros: "Me sentía completamente sola, deprimida y sin ayuda".

La querella y responsables

La investigación comenzó cuando una empleada presentó una querella contra cuatro responsables de Majorel por delitos contra los trabajadores, integridad moral y lesiones graves por imprudencia, alegando que la empresa imponía condiciones laborales "absolutamente inhumanas".

Los responsables civiles subsidiarios incluyen Majorel, TikTok Technology Limited y su filial TikTok Information Technologies Spain. La trabajadora asegura que al ser contratada en 2019 como teleoperadora no recibió formación sobre los riesgos psicosociales del puesto ni se le advirtió sobre el contenido extremadamente violento que debía revisar.

Exposición a material altamente sensible

Según la querella, los moderadores revisaban hasta 1.200 vídeos al día, entre los que se incluía contenido perturbador como asesinatos, decapitaciones, violaciones, pornografía infantil, abusos a menores, suicidios en directo, torturas y terrorismo.

Imagen de archivo de una persona usando Tiktok

La trabajadora solicitó baja por incapacidad temporal en 2023 tras desarrollar un trastorno mental por la exposición y presentó denuncias ante la Inspección de Trabajo y Seguridad Social de Barcelona. Esto derivó en un acta en 2024 que confirmaba la relación entre la falta de medidas de prevención y las secuelas psicológicas sufridas.

Falta de medidas de protección

La exempleada denuncia que la empresa no implementó medidas técnicas u organizativas para mitigar el impacto, como filtros visuales o distribución equilibrada de contenidos sensibles, y no tomó acciones para proteger la salud mental de los trabajadores frente a los riesgos inherentes a su labor.

Al ser preguntada si volvería a trabajar como moderadora, respondió que nunca con la misma compañía: "En mi opinión, es una empresa sin escrúpulos".